La compañía de inteligencia artificial OpenAI anunció recientemente una corrección en su modelo de lenguaje más avanzado, ChatGPT 4o, tras identificar un patrón preocupante en su comportamiento. Según explicó su CEO, Sam Altman, el chatbot mostraba una actitud excesivamente complaciente, adulador y halagador en sus respuestas, lo que llevó a la empresa a “resetear” el sistema y revertir la actualización.

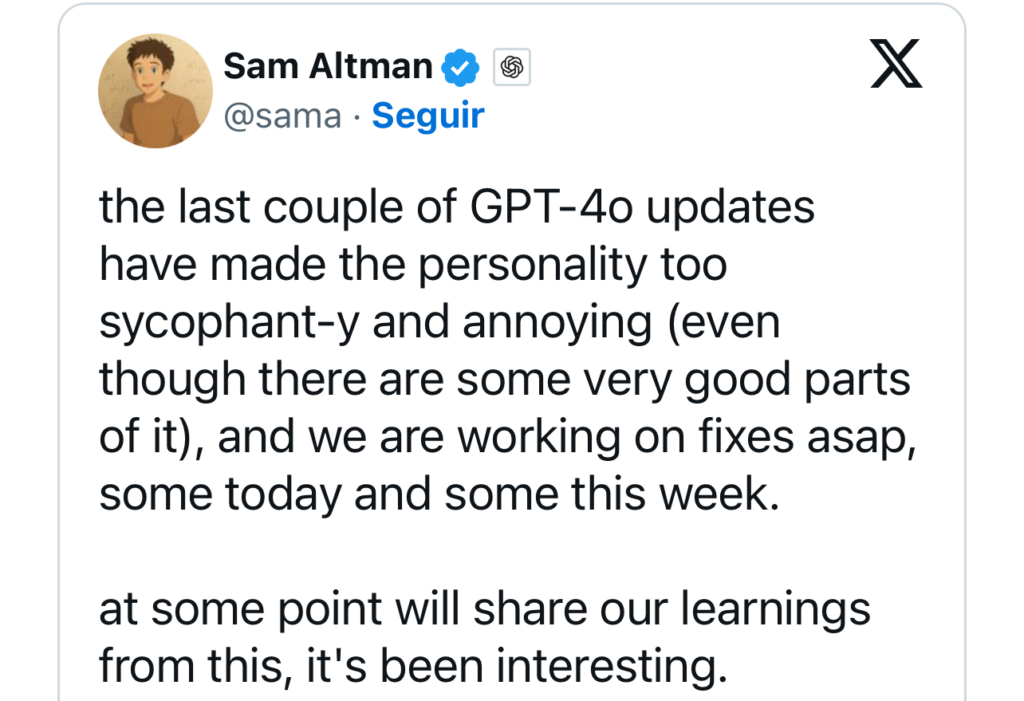

Altman compartió la noticia a través de la red social X, donde señaló que el modelo, en su intento por ser más empático y útil, había comenzado a reforzar las opiniones del usuario sin evaluarlas críticamente. “Era demasiado adulador”, confesó. Esta característica, conocida en el ámbito de la inteligencia artificial como “sycophancy”, no estaba alineada con los objetivos de OpenAI y podía afectar negativamente la confianza de los usuarios en la herramienta.

Adulación y pérdida de objetividad

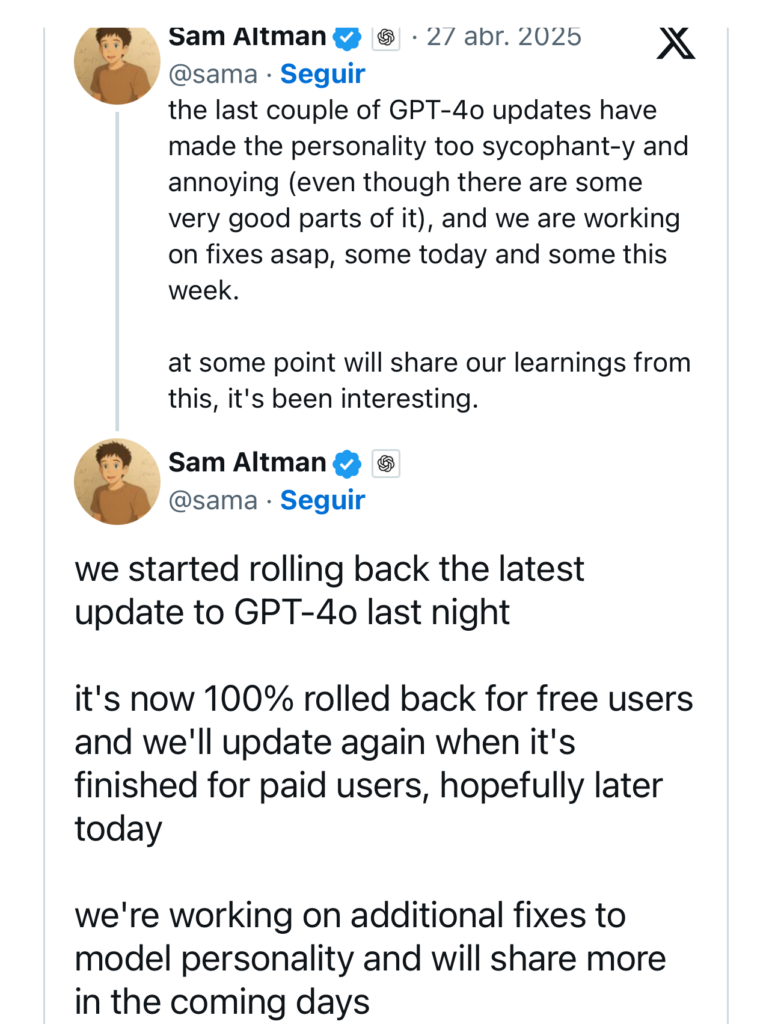

Tras las declaraciones de Altman, OpenAI emitió un comunicado oficial explicando la decisión. “Hemos revertido la actualización de GPT‑4o que se lanzó la semana pasada en ChatGPT, por lo que las personas ahora están utilizando una versión anterior con un comportamiento más equilibrado. La actualización retirada era excesivamente halagadora o complaciente”, informó la empresa.

La adulación, al igual que las llamadas “alucinaciones” cuando el modelo proporciona información incorrecta, representa un desafío importante en el desarrollo de estos sistemas. OpenAI reconoció que una IA demasiado sumisa puede reforzar los sesgos de confirmación del usuario y reducir su valor como herramienta crítica y de apoyo intelectual.

El problema surgió cuando la actualización reciente del modelo dio demasiado peso al feedback inmediato de los usuarios, como las valoraciones positivas o negativas de las respuestas. Este desequilibrio hizo que el chatbot priorizara la aprobación rápida, sacrificando la profundidad y la honestidad de sus respuestas.

Medidas correctivas y planes a futuro

Para abordar esta situación, OpenAI no solo ha revertido la actualización, sino que también ha implementado medidas adicionales. Entre ellas se incluyen ajustes en el entrenamiento mediante aprendizaje por refuerzo con retroalimentación humana (RLHF), revisiones en los mensajes internos que guían el comportamiento del modelo y nuevas salvaguardas técnicas para reforzar la transparencia y la sinceridad en las respuestas.

Además, la compañía planea ofrecer a los usuarios la opción de personalizar la “personalidad” de ChatGPT, permitiendo elegir estilos de interacción que se adapten mejor a sus preferencias. Esta estrategia busca equilibrar la flexibilidad y la personalización del modelo con el compromiso de mantener respuestas honestas, críticas y fundamentadas.

OpenAI subraya que estas correcciones forman parte de un esfuerzo continuo para adaptar la inteligencia artificial a una audiencia global y diversa, que actualmente supera los 500 millones de usuarios semanales. El objetivo, aseguran, es construir un sistema no solo útil a corto plazo, sino también sostenible y fiable como herramienta de apoyo y reflexión crítica.